Physical Address

304 North Cardinal St.

Dorchester Center, MA 02124

Physical Address

304 North Cardinal St.

Dorchester Center, MA 02124

有趣分享

有趣分享

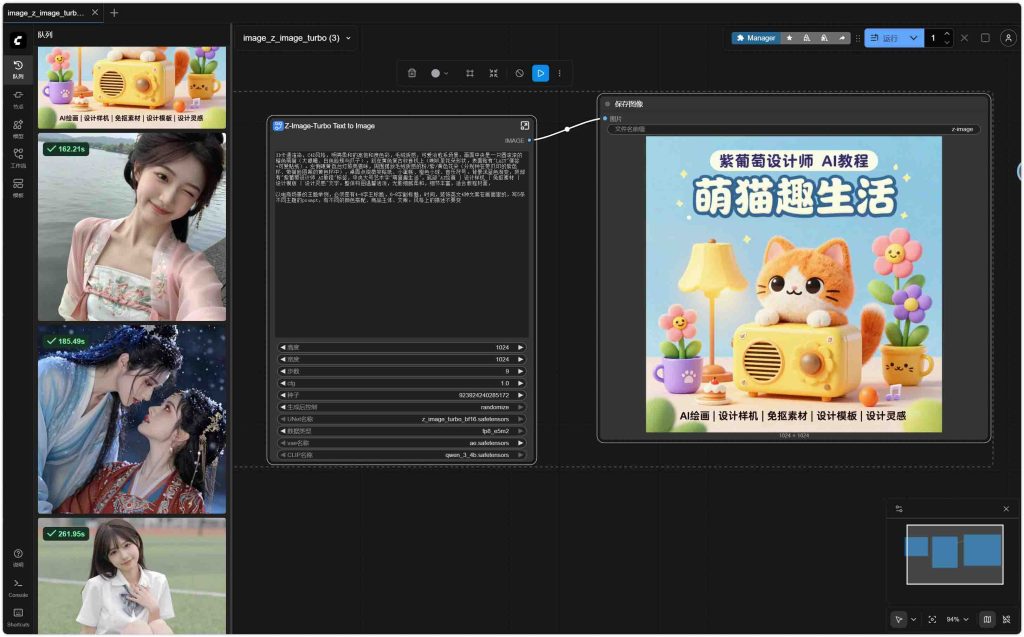

本文详细介绍了阿里开源图像生成模型 z-image-turbo 的本地部署方法,基于 ComfyUI 工作流完成模型加载、配置与生图测试,并分享了硬件要求与实际使用体验,适合希望搭建本地 AI 生图环境的用户阅读。

随着生成式 AI 在图像领域的快速发展,越来越多开发者开始关注高质量、低延迟、可本地运行的图像生成模型。

近期,阿里巴巴开源的 z-image-turbo 模型引起了不少关注,其特点是生图速度快、质量稳定、适合工作流集成,在本地部署后具备很高的自由度。

本文将结合 ComfyUI,完整介绍 z-image-turbo 的本地玩法与实际使用体验,帮助你从下载安装到成功生图,一步步完成部署。

z-image-turbo 是阿里巴巴开源的一款图像生成模型,定位为:

相比部分云端模型,z-image-turbo 的优势在于:

对于希望深入研究模型结构、提示词效果,或搭建私有生图环境的用户来说,这是一个非常值得尝试的项目。

在本地运行 z-image-turbo 时,ComfyUI 是目前最合适的承载环境之一。

ComfyUI 的优势包括:

通过工作流的方式,你可以把 模型加载、文本编码、采样、输出 等步骤清晰拆分,非常适合学习和反复实验。

在开始之前,先简单说明一下硬件与系统要求:

⚠️ 关于 Mac 用户说明

目前在 macOS(尤其是 M 系列芯片)上运行该工作流,可能会遇到 PyTorch 与 CUDA 兼容问题,稳定性较差,不太推荐作为主力环境。

前往 ComfyUI 官方网站下载对应版本:

👉 https://comfy.org/zh-cn/download

按照说明解压并启动即可,无需复杂安装过程。

官方已提供现成的 ComfyUI 工作流模板,可直接使用:

👉

https://github.com/Comfy-Org/workflow_templates/blob/main/templates/image_z_image_turbo.json

将该 JSON 文件下载到本地备用。

操作非常简单:

image_z_image_turbo.json系统会自动解析并加载完整工作流节点。

导入工作流后,ComfyUI 会提示你:

按照提示完成下载,并放入 ComfyUI 对应的模型目录中即可。

⚠️ 注意事项:

当模型加载完成后:

此时模型就会开始在本地生成图片。

在实际测试中,z-image-turbo 的表现主要体现在:

对于学习提示词工程、研究模型表现差异、搭建私有图像生成环境,都非常合适。

在 NVIDIA GTX 1080 上测试时:

但整体仍然可用且稳定,只是需要一定耐心。

如果你对效率有更高要求,建议使用 RTX 系列显卡。

这套本地玩法,特别适合:

如果你只是偶尔生图,云端工具可能更方便;

但如果你追求自由、可控、研究价值,那本地部署一定值得一试。

z-image-turbo 作为阿里开源的图像生成模型,在性能与开放性之间取得了不错的平衡。

结合 ComfyUI 的工作流体系,本地部署后可以构建一个高度可定制的生图环境。

如果你已经有一定的 AI 绘画或 ComfyUI 使用经验,这套玩法会给你带来更多探索空间。